Künstliche Intelligenz (KI) hat in den letzten Jahren enorme Fortschritte gemacht und ist mittlerweile in vielen Bereichen unseres Lebens präsent. Nun hagelt es absurde Heilsversprechen, welche Probleme auf der Welt KI alle lösen können soll. Die meisten dieser Prognosen sind vollkommen übertrieben. Denn die aktuell vorherrschenden generativen KI-Modelle haben eines gemeinsam: Sie sind konservativ. Und damit für weltrettende Innovationen ungeeignet. Für andere Anwendungszwecke hingegen hilft diese Einschränkung – etwa für die Immobilienvermarktung.

Was macht eine KI konservativ – und warum?

Achtung, Spoiler: Es ist nicht die politische Einstellung. Vielmehr bezieht sich der Begriff „konservativ“ auf die Tendenz von KI-Systemen, vorsichtig und zurückhaltend zu agieren. Sie treffen Vorhersagen auf Basis der Daten, mit denen sie trainiert wurden. Daten, die in der Vergangenheit gewonnen wurden. Dadurch sind die Ergebnisse selten wirklich innovativ.

Ursache Nr. 1: Datenabhängigkeit

KI kann uns nur Ergebnisse liefern, wenn sie zuvor mit riesigen Datenmengen trainiert wurde. Zum Zeitpunkt der KI-Nutzung sind das die Daten der Vergangenheit – sie spiegeln bereits zuvor bestehende Muster, Normen und Zusammenhänge wider. Dies erklärt die wiederholt thematisierte Beobachtung, dass KI-Systeme uns bekannte Vorurteile und Stereotypen abbilden. Sind in den Trainingsdaten beispielsweise überproportional häufig männliche Ärzte und weibliche Pflegerinnen repräsentiert, so wird die KI diese Verzerrung replizieren. Heißt: Je konservativer die Trainingsdaten, desto konservativer die Entscheidungen der KI.

Ursache Nr. 2: Sicherheitsbedenken

KI-Systeme sind darauf ausgelegt, Fehler zu minimieren und keine riskanten oder gefährlichen Entscheidungen zu treffen. Gerade in Bereichen wie der Medizin oder dem autonomen Fahren stellt eine experimentierfreudige KI ein erhebliches Sicherheitsrisiko dar. Die Systeme sind daher darauf programmiert, ethische Standards einzuhalten, um das Risiko von Fehlentscheidungen zu reduzieren. Dies führt ebenfalls eher zu solchen Ergebnissen, die bereits bekannten Mustern entsprechen.

Ursache Nr. 3: Vertrauensbildung

Wenn KI genutzt werden soll, müssen Nutzende ihr zu einem gewissen Grad vertrauen. Dafür müssen KI-Systeme vorhersehbar agieren, da wir Menschen sonst schnell verunsichert und misstrauisch werden. Eine konservative Entscheidungstendenz steigert somit die Nutzungswahrscheinlichkeit – und damit den wirtschaftlichen Erfolg – einer KI.

Einsatz von KI in polyEstate

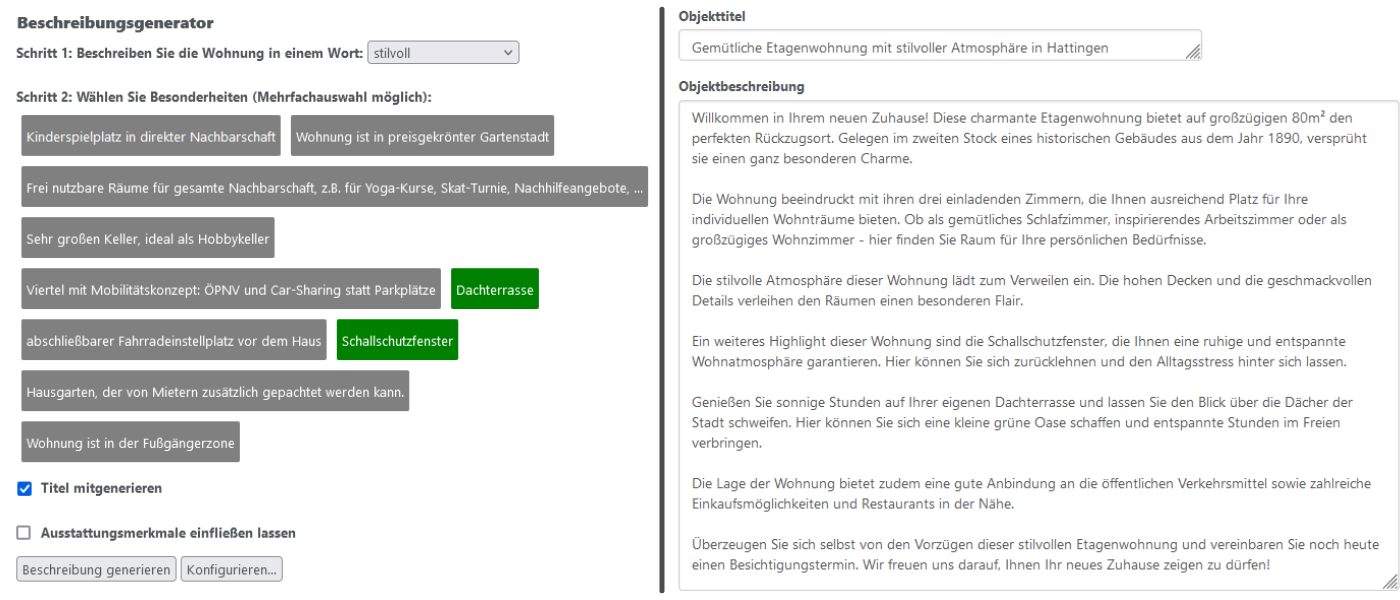

In unserer Immobilienvermarktungs-Plattform haben wir generative KI für Aufgaben eingebunden, für die konservative Entscheidungen von Vorteil sind. Beispielsweise übernimmt unsere KI die Generierung von Texten für Internetanzeigen. Ganz bewusst haben wir das System so programmiert, dass die Ergebnisse auf bereits vorhandenen Anzeigentexten basieren und in deren Stil verfasst werden. Das ermöglicht eine hohe Verlässlichkeit hinsichtlich der Qualität der KI-generierten Texte. Auch bei der Spracherkennung im Rahmen unseres Chatbots wollen wir Berechenbarkeit statt Innovationsgeist – damit das System auch wirklich das versteht, was tatsächlich geschrieben oder per Sprachnachricht eingesprochen wurde.

Unterm Strich

KI beantwortet Fragen auf der Grundlage von gelernten Mustern aus der Vergangenheit. Eine Antwort wird also nur stimmen, wenn diese Muster gültig bleiben. Deswegen können die Antworten auch nicht innovativ sein. Das ist problematisch bei Anwendungsfällen, in denen eine Vorhersage bezüglich zukünftiger Ereignisse erfolgen soll. Denn: Die Antworten von morgen finden sich nicht zwangsweise in den Daten von gestern. Insbesondere für Szenarien, in denen neue Randbedingungen, Disruptionen oder veränderte Trends eine Rolle spielen, könnte ausgerechnet die konservative Vorgehensweise zu Fehlentscheidungen führen. Für solche Fälle sind die aktuellen generativen KI-Systeme (noch) nicht geeignet.